MetaHuman Animator: Tạo nhân vật 3D từ video iPhone chỉ trong ít phút

Ngành Game đang chứng kiến một bước tiến công nghệ mới với công cụ tạo hoạt ảnh 3D trong thời gian cực ngắn nhờ bộ nhận diện khuôn mặt tinh vi: MetaHuman Animator.

Hàng năm tại Game Developers Conference (GDC – Hội nghị Nhà phát triển Trò chơi điện tử), một số ít các công ty sẽ trình diễn công nghệ ghi lại chuyển động mới nhất của họ. Những công nghệ tân tiến này giúp biến các hoạt động của con người thành hoạt ảnh 3D có thể sử dụng trong trò chơi. Thông thường, những màn trình diễn kỹ thuật này đòi hỏi rất nhiều phần cứng chuyên dụng để ghi lại hiệu suất và xử lý tốt trên máy tính cũng như việc tinh chỉnh thủ công của các Artist để đưa dữ liệu kết quả vào trạng thái sẵn sàng sử dụng.

Tuy nhiên, công cụ MetaHuman Animator sắp ra mắt của Epic có vẻ sẽ cách mạng hóa quy trình làm việc tốn nhiều công sức và thời gian này.

Buổi demo ấn tượng

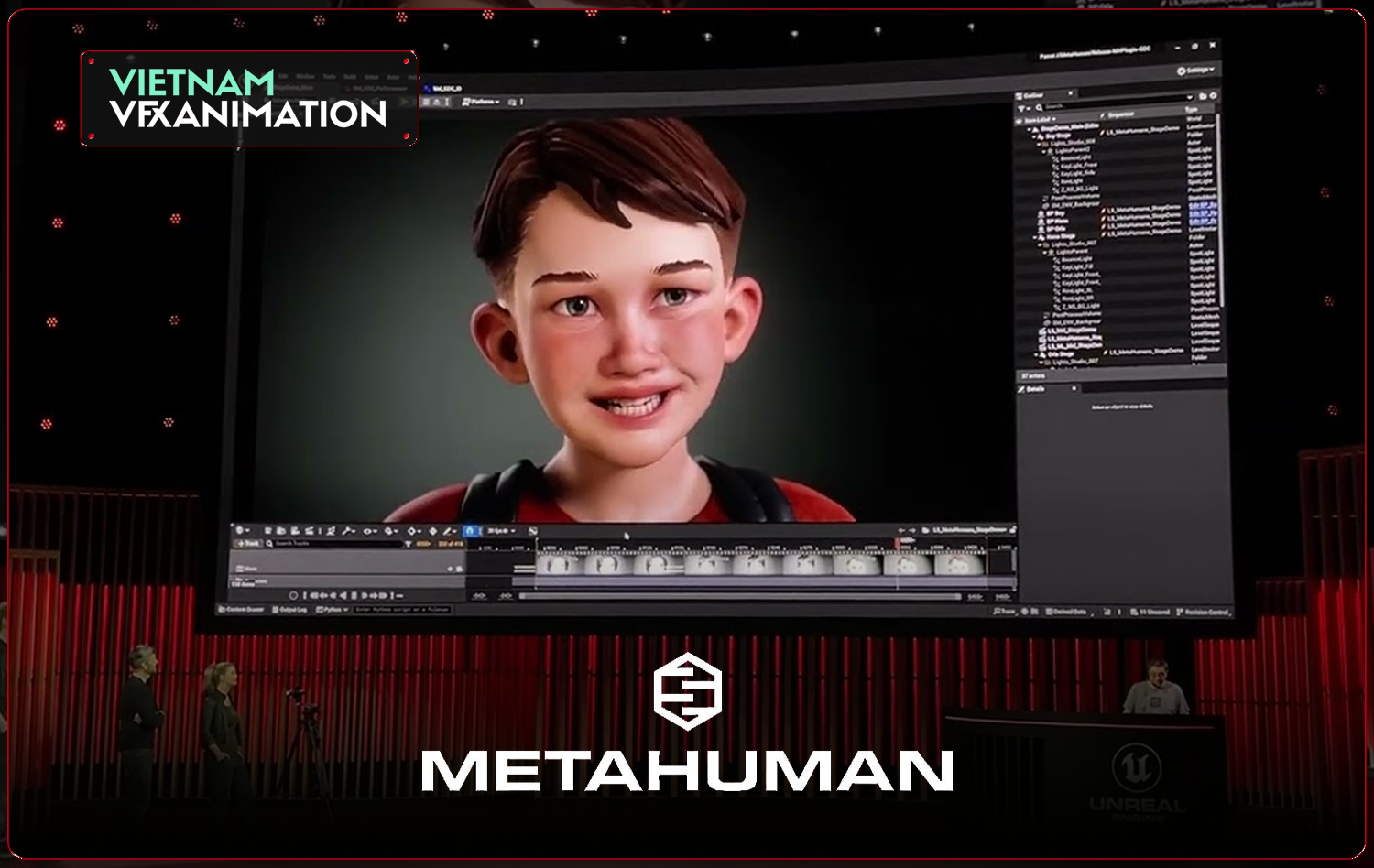

Tại GDC diễn ra ở San Francisco gần đây, Epic Games – công ty sản xuất và phát hành game và phần mềm nổi tiếng của Hoa Kỳ – đã gây ấn tượng với màn trình diễn biến một video iPhone thành hoạt ảnh 3D chỉ trong ít phút nhờ công nghệ mới MetaHuman Animator.

Màn demo của Epic Games tại GDC 2023

Công nghệ hoạt hình tự động mới này được phát triển dựa trên nền tảng là công cụ tạo model MetaHuman của Epic đã được ra mắt trước đó vào năm 2021. MetaHuman hỗ trợ việc tạo các mô hình con người có độ chi tiết cao trong Unreal Engine 5. Epic cho biết kể từ khi ra mắt, hơn 1 triệu người dùng đã tạo ra hàng triệu MetaHuman, một số nhân vật hoàn thành chỉ trong ít phút từ thông tin đầu vào là ba bức ảnh khuôn mặt người.

Vấn đề chính với những MetaHuman này, như Mastilovic đã trình bày trên sân khấu GDC, là “việc tạo hoạt ảnh từ chúng vẫn không dễ dàng.” Theo Mastilovic, ngay cả những hãng phim lành nghề cũng thường cần sử dụng “chụp 4D” chi tiết nhờ phần cứng chuyên dụng và “thời gian xử lý hàng tuần hoặc hàng tháng” kết hợp với việc tinh chỉnh của con người để có được hoạt ảnh sẵn sàng sử dụng được trong trò chơi.

Epic đã chứng minh rằng công cụ mới MetaHuman Animator có thể tăng tốc và nâng cấp quá trình tạo hoạt ảnh 3D với màn thể hiện trực tiếp của Nghệ sĩ trình diễn Melina Juergens từ Ninja Theory, vốn được biết đến với vai Senua trong game Hellblade: Senua’s Sacrifice năm 2017.

Màn trình diễn trên sân khấu kéo dài 15 giây của Juergens được ghi lại trên một chiếc iPhone gắn trên giá ba chân trước mặt cô. Video gốc này sau đó được xử lý trên máy AMD cao cấp trong vòng chưa đầy 1 phút, tạo ra hoạt ảnh 3D thực tế mượt mà đến mức không thể phân biệt được với video gốc.

Màn demo MetaHuman Animator thu hút tràng pháo tay lớn từ các nhà phát triển game

Những chi tiết nhỏ trong màn trình diễn của Juergens – từ hàm răng nhe ra cho đến cái mấp máy miệng cực nhỏ cho đến những cái liếc xéo – tất cả đều được bảo toàn trong hoạt ảnh 3D. Mastilovic cho biết, ngay cả những chuyển động thực tế của lưỡi cũng được chuyển đổi từ âm thanh đã ghi nhờ sử dụng thuật toán “từ âm thanh đến lưỡi”.

Hơn nữa, Epic cũng chỉ ra cách tất cả những tật máy (tức sự co của một hoặc nhiều nhóm cơ xảy ra đột ngột và lặp lại) trên khuôn mặt có thể được áp dụng không chỉ cho mô hình MetaHuman của riêng Juergens mà còn cho bất kỳ mô hình nào được xây dựng trên cùng một tiêu chuẩn MetaHuman. Việc nhìn thấy những chuyển động và lời nói của Juergens phát ra từ miệng của một nhân vật hoạt hình 3D chỉ vài phút sau màn nhập vai trực tiếp thật là một màn trình diễn ấn tượng.

(Nguồn ảnh: Arstechnica)

MetaHuman Animator biến video iPhone thành hoạt ảnh 3D như thế nào?

Điều quan trọng là đảm bảo hệ thống hiểu được cấu trúc giải phẫu độc đáo trên khuôn mặt của diễn viên và điều đó sẽ liên quan như thế nào đến nhân vật mục tiêu của bạn. MetaHuman Animator bắt đầu bằng cách tạo một “Danh tính MetaHuman” cho nghệ sĩ. Nếu từng sử dụng tính năng “từ Lưới thành MetaHuman” (Mesh to MetaHuman), bạn sẽ biết rằng một phần của quy trình ấy đến từ quá trình quét hoặc điêu khắc 3D. MetaHuman Animator được xây dựng dựa trên công nghệ đó để cho phép tạo ra Danh tính MetaHuman chỉ từ một lượng nhỏ cảnh quay. Quá trình này chỉ mất vài phút và chỉ cần thực hiện một lần cho mỗi diễn viên.

(Nguồn ảnh: fxguide)

Sau khi hoàn thành bước trên, bằng cách theo dõi và xử lý các vị trí của giàn khuôn mặt MetaHuman, ta có thể phân tích màn trình diễn của nghệ sĩ. Đầu tiên, “bộ giải khuôn mặt và trình phát hiện mốc” của Epic xác định các điểm rigging chính trên khuôn mặt được quay video. Sau đó, bằng cách sử dụng các điểm đó, một thuật toán học máy về cơ bản sẽ ánh xạ từng khung hình video tới “hàng xóm” gần nhất của nó trong cơ sở dữ liệu đa chiều khổng lồ về các khuôn mặt được chụp. Thuật toán sử dụng một “giải pháp không gian ngữ nghĩa” mà Mastilovic cho biết sẽ đảm bảo hình ảnh động thu được “luôn hoạt động giống nhau cho bất kỳ khuôn mặt nào… không bị biến dạng khi bạn di chuyển nó sang một nơi khác.”

(Nguồn ảnh: Arstechnica)

Kết quả là mọi biểu cảm tinh tế đều được tái tạo chính xác trên nhân vật MetaHuman, bất kể sự khác biệt giữa diễn viên và các tính năng của MetaHuman. Trong Unreal Engine, bạn có thể xác nhận trực quan diễn xuất trực tiếp của nghệ sĩ và so sánh MetaHuman Identity động với cảnh quay của diễn viên trên từng khung hình.

Một bước tiến đáng gờm có khả năng thay đổi cuộc chơi ngành Game

Không giống như một số mô hình học máy khác, Mastilovic cho biết MetaHuman Animator “không bỏ qua bất kỳ chi tiết nào.” Trọng tâm là tạo hoạt ảnh khớp chính xác với chuyển động khuôn mặt được đưa vào. Và Mastilovic cho biết mô hình này vẫn hoạt động tốt dù trong điều kiện ánh sáng yếu và hậu cảnh gây mất tập trung.

Các công cụ ghi lại chuyển động để tạo dữ liệu hoạt hình trong một khoảng thời gian ngắn không phải điều hoàn toàn mới – chính Epic đã trình diễn một thứ tương tự vào năm 2016, sử dụng màn biểu diễn thời gian thực của một cảnh Hellblade. Tuy nhiên, vào thời điểm đó, màn trình diễn yêu cầu Juergens phải được trang bị các chấm theo dõi và trang điểm đặc biệt, đồng thời đeo một giàn máy ảnh và ánh sáng gắn trên đầu. Và kết quả là mô hình “thời gian thực”, mặc dù rất ấn tượng vào thời điểm đó, lại phù hợp cho việc “hình dung” nhân vật nhanh chóng hơn là một sản phẩm mượt mà hoàn chỉnh, sẵn sàng để render.

(Nguồn ảnh: IGN)

Công nghệ mới này khiến việc có công cụ chụp chuyển động khuôn mặt riêng biệt là không cần thiết, giúp bạn có thể thực hiện chỉ với một chiếc iPhone. Sản phẩm hoạt ảnh chưa chỉnh sửa thông qua Unreal Engine có nhiều sắc thái, đồng thời cung cấp một khuôn khổ mà các nhà làm phim hoạt hình có thể điều chỉnh và tinh chỉnh thêm. Đối với ngành công nghiệp game vốn yêu cầu khối lượng lớn hoạt hình CG, công nghệ này rất có thể là một yếu tố thay đổi cuộc chơi.

Ngoài ra, ngay cả các nhà phát triển nhỏ cũng có thể tận dụng MetaHuman Animator mới của Epic để sáng tạo hoạt hình 3D chất lượng cao mà không cần đầu tư quá nhiều thời gian hay công sức. Mastilovic cho biết ông hy vọng sự ra mắt rộng rãi của công cụ vào mùa hè này sẽ dẫn đến “dân chủ hóa các công nghệ nhân vật phức tạp” bằng cách “cho phép bạn làm việc nhanh hơn và xem kết quả ngay lập tức.”

MetaHuman Animator được lên kế hoạch phát hành trong vài tháng tới và sẽ là một phần của plugin Metahuman cho Unreal Engine.

Thuy Le

Nguồn: Arstechnica, Unreal Engine